(請提交驗證碼通過手機驗證)

時間:2023-09-26 09:00:18

35245

35245

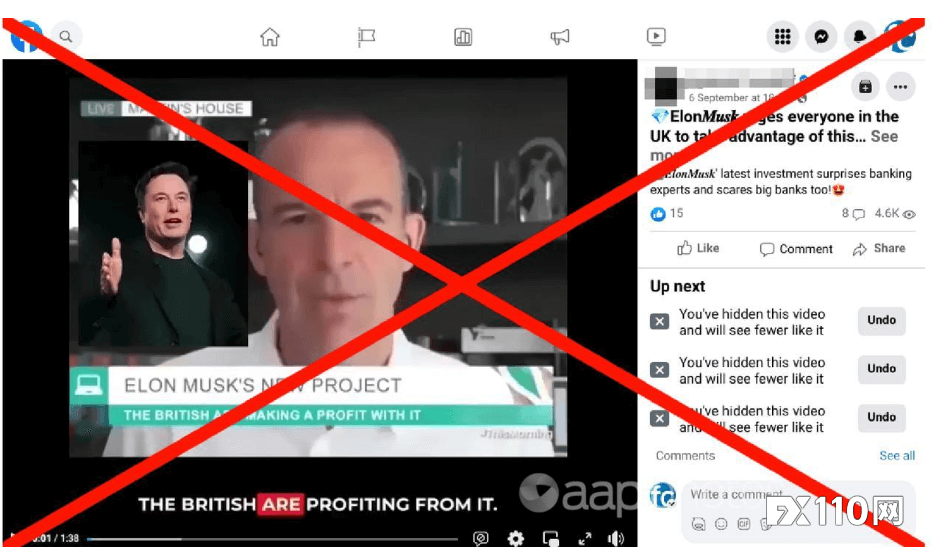

此前,一段社交媒體影片展示了英國受人尊敬的財經記者馬丁·劉易斯(Martin Lewis)宣傳伊隆·馬斯克(Elon Musk)的新交易平台量子人工智慧(Quantum AI)。該影片有數千次觀看,並在社群媒體上廣泛分享。不過,這個影片是假的!

劉易斯已證實該影片是使用人工智慧 (AI) 深度偽造的,馬斯克尚未推出名為「量子人工智慧」的計畫。假影片中,劉易斯說道「馬斯克的新專案帶來了巨大的投資機會」。

劉易斯是英國最受尊敬的財經記者之一,被稱為「英國最值得信賴的人」。深度造假者利用他的個人資料來欺騙觀眾相信這個捏造的計畫。

「這太可怕了,這是我見過的第一個深度造假影片騙局。政府和監管機構必須加緊阻止大型科技公司發佈此類危險的假貨。人們會失去金錢並毀掉生活。」劉易斯說道,「我的朋友有時會聯繫我說‘嘿,我剛剛在你宣傳的投資計畫中投入了一些錢’。」

這並不是所謂的「AI智能」第一次被用於詐騙。英國東安格利亞大學網路安全專家奧利·巴克利教授表示,所需的技術很容易獲得。

「例如,我可以使用任意數量的網站創建某人的聲音克隆,其中包含 30-60 秒的音頻,」巴克利教授說。

「我最近為某人做了一個演示……我能夠通過 1 分鐘的錄音和網路連接,非常準確地複製他們的聲音。」

南佛羅里達大學人工智慧研究員助理教授約翰·利卡暗樁 (John Licato) 表示,複製名人的音頻特別容易,因為你只需要幾個樣本。

「我想說,通過一個小時左右的努力/學習,你可以獲得相當引人注目的東西。」巴克利教授表示,視覺生成並不困難,網上有大量軟體可供使用。

巴克利教授表示,在查看可疑的深度偽造品時,關鍵是要保持批判性和懷疑性。「不自然的陰影、光線和膚色等通常都是很好的指標。通常,當你看到某些東西時,你會感覺不太對勁——作為人類,我們非常擅長發現模式,」他說。

在提到影片時,他補充道:「馬丁·劉易斯看起來不太對勁,他凝視的方式非常激烈,他的頭非常靜止,感覺他所說的和他的表情之間存在脫節。同樣,伊隆·馬斯克經常向左看,他的表情(特別是眼睛和眉毛周圍)似乎不正常或不自然。」

他補充說,詢問影片來源仍然是檢查其真實性的可靠方法。( 相關閱讀:殺豬盤!愛情詐騙!泰國高管網戀假美軍慘賠62億 )

如果展示名人或名人宣傳新產品的帖子包含以下一項以上功能,則應謹慎對待:

人們說話有不尋常的停頓,說話方式生硬不一致的口音。

他們的嘴部動作與講話不同步,或者他們的面部表情和動作與講話語氣不相符。

影片解析度低或斷斷續續。

影片的來源和/或上下文不清楚。

更多FX110 影音內容

維權1時間、活動花絮、交易員採訪不定期更新中!歡迎前往 Youtube 觀看

FX110 網站功能探搜

暫時還沒評論,來留下你的印象吧

評論發表成功

評論